Trong kỷ nguyên số, "tích hợp AI" không còn là một tính năng xa xỉ mà đã trở thành tiêu chuẩn bắt buộc để cạnh tranh. Từ việc tự động hóa chăm sóc khách hàng bằng chatbot, phân tích dữ liệu lớn đến cá nhân hóa trải nghiệm người dùng, AI đang len lỏi vào mọi ngóc ngách của các sản phẩm công nghệ.

Thế nhưng, có một sự thật phũ phàng: Rất nhiều doanh nghiệp hăm hở tích hợp AI vào hệ thống hiện tại, để rồi nhận ra toàn bộ nền tảng của họ nhanh chóng "sập nguồn" hoặc chậm như rùa bò.

Tại sao lại như vậy? Và làm thế nào để thiết kế một hệ thống có khả năng mở rộng (Scalability) thực sự "AI-Ready"? Cùng tìm hiểu trong bài viết dưới đây.

Tại sao kiến trúc truyền thống thường "gãy" khi tích hợp AI?

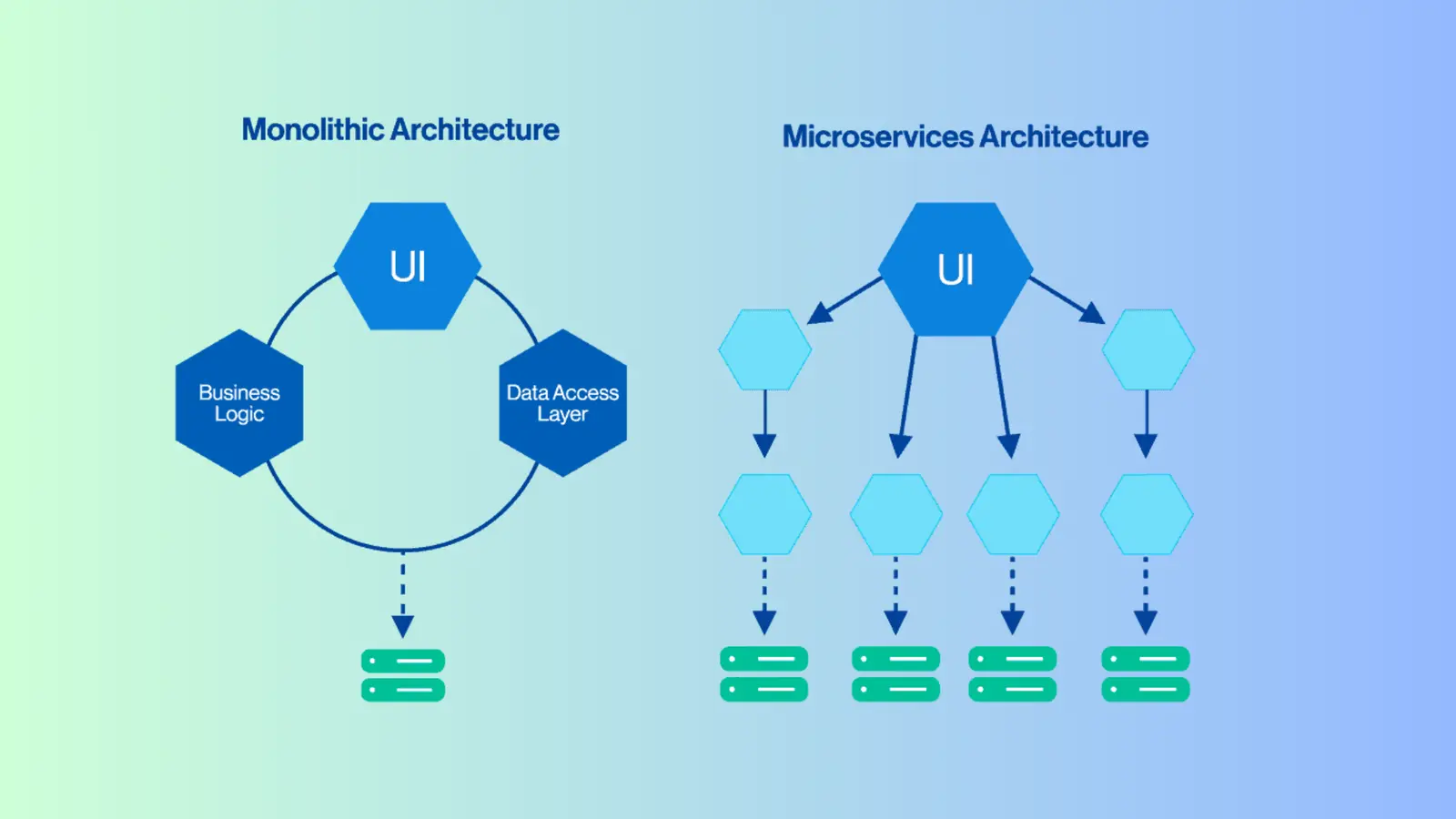

Hầu hết các hệ thống phần mềm truyền thống (đặc biệt là kiến trúc Monolith nguyên khối) được thiết kế cho các tác vụ có tính chất xác định (deterministic) và phản hồi nhanh (low latency). Ví dụ, một truy vấn database lấy thông tin người dùng thường chỉ mất khoảng 50ms.

Tuy nhiên, khi bạn nhúng các mô hình Trí tuệ nhân tạo (đặc biệt là Generative AI hay Machine Learning nặng) vào kiến trúc này, hệ thống sẽ bộc lộ 3 điểm yếu chí mạng:

- Nút thắt cổ chai về độ trễ (Latency Bottleneck): Các API của AI thường mất từ vài giây đến hàng chục giây để xử lý (ví dụ: chờ LLM sinh ra văn bản). Nếu hệ thống cũ sử dụng giao tiếp đồng bộ (Synchronous), các luồng (threads) của Web Server sẽ bị "treo" để chờ AI phản hồi. Chỉ cần một lượng nhỏ người dùng gọi AI cùng lúc, server sẽ cạn kiệt tài nguyên (Thread Pool Exhaustion) và sập hoàn toàn.

- Tiêu thụ tài nguyên bất đối xứng: Core nghiệp vụ (đăng nhập, giỏ hàng) tốn rất ít CPU/RAM. Ngược lại, xử lý Vector Database hay chạy AI Model lại ngốn lượng tài nguyên khổng lồ. Ở kiến trúc cũ, bạn không thể cấp phát tài nguyên độc lập cho khối AI, dẫn đến lãng phí server hoặc quá tải cục bộ.

- Luồng dữ liệu (Data Pipeline) cứng nhắc: AI "sống" bằng dữ liệu. Các hệ thống cũ thường khóa chặt dữ liệu trong các relational database (SQL) và thiếu cơ chế truyền tải sự kiện thời gian thực (Event-driven). Điều này khiến AI không có luồng dữ liệu liên tục để học hỏi và đưa ra dự đoán chính xác.

Modular & Microservices: "Kháng thể" cho hệ thống AI-Ready

Để giải quyết bài toán Scalability, chúng ta không thể nhồi nhét code gọi API AI vào giữa Business Logic hiện tại. Giải pháp tối ưu nhất là áp dụng kiến trúc Modular hoặc Microservices, tách biệt hoàn toàn phần "Não AI" ra khỏi "Cơ thể vận hành".

Dưới đây là 3 nguyên tắc thiết kế hệ thống có khả năng mở rộng mạnh mẽ:

1. Giao tiếp bất đồng bộ (Asynchronous Communication)

Thay vì bắt Web Server chờ AI trả lời, hãy đặt một Message Queue (như Kafka, RabbitMQ) ở giữa. Khi User gửi yêu cầu, hệ thống ghi nhận vào Queue rồi trả về thông báo "Đang xử lý". Các Worker Node chứa AI sẽ âm thầm lấy task từ Queue ra xử lý, sau đó bắn thông báo (qua Webhook hoặc Websocket) lại cho User. Nhờ vậy, hệ thống core hoàn toàn không bị block.

2. Khả năng mở rộng độc lập (Independent Auto-scaling)

Với kiến trúc Microservices, bạn có thể thiết lập Auto-scaling riêng cho cụm AI. Vào ngày bình thường, hệ thống chỉ chạy 2 node AI. Nhưng khi có chiến dịch Marketing khiến lượng truy cập tăng đột biến, hệ thống có thể tự động scale lên 20 node AI mà không làm ảnh hưởng đến hiệu suất của server quản lý đơn hàng.

3. Tính module hóa linh hoạt (Pluggability)

Hãy thiết kế hệ thống theo dạng các "ổ cắm". Core system chỉ định nghĩa các interface (cổng giao tiếp) rõ ràng. Bất kỳ AI Service nào tuân thủ đúng định dạng dữ liệu (JSON/gRPC) đều có thể cắm vào hoặc rút ra mà không làm hỏng toàn bộ hệ thống.

Case Study Thực Tiễn: Tích hợp Module AI (OneBot) vào hệ thống hiện có

Để dễ hình dung, giả sử bạn muốn tích hợp OneBot (một module AI chuyên xử lý ngôn ngữ tự nhiên) vào một hệ thống CRM cũ. Nếu xây dựng theo chuẩn "AI-Ready", quy trình sẽ diễn ra cực kỳ mượt mà:

- Không sửa Core, chỉ thêm API Gateway: Bạn không cần đập đi viết lại CRM. Chỉ cần cấu hình API Gateway để định tuyến (route) các tin nhắn của khách hàng sang hệ thống của OneBot.

- Lắng nghe sự kiện (Event-Driven): Thay vì CRM phải liên tục "hỏi" OneBot xem có kết quả chưa, OneBot tự hoạt động như một module độc lập. Khi phân tích xong, nó tự động gọi một Webhook đẩy dữ liệu (đã được cấu trúc hóa) ngược lại vào CRM để tạo Ticket.

- Dễ dàng nâng cấp thuật toán: Vì OneBot được cắm vào qua cơ chế Modular, khi mô hình AI lõi được nâng cấp (ví dụ từ GPT-3.5 lên GPT-4), hệ thống CRM của bạn không cần sửa dù chỉ một dòng code.

Key takeaway: Đừng xây dựng một hệ thống "đóng", hãy xây dựng một hệ thống "sẵn sàng cho AI".

Tương lai của công nghệ không nằm ở việc bạn đang dùng thuật toán AI nào xịn nhất hôm nay, mà nằm ở việc kiến trúc phần mềm của bạn có đủ linh hoạt để "hấp thụ" những công nghệ đột phá của ngày mai hay không. Việc tối ưu Scalability thông qua kiến trúc Microservices, Modular và giao tiếp bất đồng bộ chính là tấm vé bắt buộc để doanh nghiệp phát triển bền vững trong kỷ nguyên trí tuệ nhân tạo.

Bạn đang gặp khó khăn trong việc thiết kế kiến trúc hệ thống để tích hợp AI? Hãy liên hệ với chúng tôi để được tư vấn các giải pháp System Development Best Practices phù hợp nhất cho doanh nghiệp của bạn!